أصدر نظام الديجيتال الوطني بالتعاون مع دائرة الاستشارات والتشريع في وزارة العدل ووزارة الابتكار والعلوم والتكنولوجيا أول دليل حكومي من نوعه حول الاستخدام المسؤول للذكاء الاصطناعي في القطاع العام.

هذا الدليل يقترح نهجًا منظمًا، قيميًا ومبتكرًا لإدماج تقنيات الذكاء الاصطناعي بشكل مدروس في الخدمات العامة.

عليكم أن تعرفوا

الذكاء الاصطناعي (AI) أصبح جزءً من حياتنا اليومية، بدءً من خدمات البحث والترجمة، مرورًا بالاستشارات الصحية والنفسية، وصولًا إلى المساعدين الأذكياء في الهاتف المحمول الذين ينفذون كل ما نطلبه.

إستخدام الذكاء الاصطناعي يمكن أن يسهل الحياة كثيرًا، لكن للإستفادة من مزاياه وتقليل مخاطره، من المهم معرفة كيفية التعامل معه بطريقة ذكية وآمنة.

لهذا، ركز نظام الديجيتال الوطني خمسة نصائح أساسية تساعد كل شخص على استخدام الذكاء الاصطناعي بمسؤولية:

النتائج ليست دائمًا موثوقة

أنظمة الذكاء الاصطناعي تولد إجابات استنادًا إلى معلومات موجودة مسبقًا، لكنها لا "تعرف" حقًا. النظام لا يفكر فعليًا ولا يدرك ما يحدث على أرض الواقع. أحيانًا يقدم معطيات غير دقيقة، أرقامًا خاطئة أو صياغات مربكة تبدو مقنعة جدًا.

على سبيل المثال، قد تحصلون على إجابة حول موضوع تاريخي بتاريخ غير صحيح، أو ملخص لمقال غير موجود أساسًا.

لذلك، إذا اعتمدتم على معلومات من الذكاء الاصطناعي للعمل، الدراسة أو اتخاذ قرارات شخصية، من المهم التحقق منها عبر مصادر إضافية للتأكد من مصداقيتها.

الحفاظ على المعلومات الخاصة

كثير من أدوات الذكاء الاصطناعي المجانية تجمع وتخزن المعلومات التي يدخلها المستخدمون من أجل توليد الإجابات. هذا يعني أن أي معلومة شخصية مثل رقم هوية، بيانات طبية، كلمة مرور أو تفاصيل عن مكان العمل، قد تُخزن في خوادم وربما تكون متاحة لأطراف أخرى غير موثوقة.

بعض الأنظمة المدفوعة تتيح خيار منع تخزين المعلومات أو استخدامها للتدريب، لكن التوصية الأساسية تبقى: لا تدخلوا بيانات شخصية أو حساسة أو معلومات لا ترغبون بكشفها لآخرين.

متابعة استخدام الأطفال وكبار السن محدودي المعرفة الرقمية

كما نراقب تصفح الأطفال للإنترنت، يجب مراقبة استخدامهم للذكاء الاصطناعي. فقد يتعرض الأطفال لمحتوى غير ملائم لأعمارهم أو يستخدمون الذكاء الاصطناعي لإنتاج محتوى إشكالي. أيضًا كبار السن أو من لديهم مهارات رقمية محدودة قد يعتمدون على إجابات غير صحيحة ويتضررون منها، سواء في الجوانب الصحية أو الاقتصادية.

لذلك يُنصح بمرافقة الاستخدام الأولي، وفتح نقاشات مسبقة وشرح طرق الاستخدام الصحيحة، وأحيانًا حتى الإشراف المباشر. الهدف هو بناء ثقافة استخدام مسؤولة داخل العائلة، المجتمع، والمجتمع الأوسع.

الاستخدام وفقًا لشروط الخدمة

لكل نظام ذكاء اصطناعي قواعد واضحة تحدد المسموح والممنوع والقيود القائمة. أحيانًا لا يُسمح باستخدام المخرجات لأغراض تجارية، وفي أحيان أخرى يُحظر إنتاج أنواع معينة من المحتوى، أو توجد قيود لحقوق النشر على النصوص والصور المنتجة.

قبل استخدام المخرجات (إجابات أو منتجات) لأغراض مهنية، نشر أو بحث، من المهم قراءة شروط الاستخدام لتفادي مخالفات قانونية أو تعقيدات.

التوافق مع إطار العمل أو الدراسة

المدارس، الجامعات وأماكن العمل تضع قواعد واضحة بشأن استخدام الذكاء الاصطناعي. مثلًا، في الأوساط الأكاديمية، لا يُسمح دائمًا بتقديم وظيفة أُنجزت بمساعدة أدوات الذكاء الاصطناعي. أما في أماكن العمل، فقد تكون هناك قيود على إدخال معلومات – سرية أو عادية – إلى أنظمة خارجية.

الاستخدام غير المتوافق مع السياسة قد يؤدي إلى خلافات، وفي حالات قصوى حتى إلى جلسة استماع أو فصل. لذا من المهم معرفة السياسات المعتمدة في مكانكم والعمل وفقًا لها وبحكمة.

ننصحكم بالاطلاع على الدليل، فهو يحتوي على مبادئ وإرشادات لاستخدام صحيح للذكاء الاصطناعي في القطاع المدني، التجاري والعام: https://www.gov.il/he/pages/ai-guide

عرضت جيم ستوب شراء جميع أسهم عملاق البيع بالتجزئة عبر الإنترنت إيباي في صفقة تُقدّر قيمتها بنحو 56 مليار دولار، في خطوة غير مألوفة تسعى فيها الشركة للاستحواذ على...

أفادت وكالة الأنباء الفرنسية (أ ف ب)، نقلاً عن بيان حصلت عليه، أن أكثر من 600 موظف في جوجل وقّعوا عريضة تطالب...

في خطوة تعكس موجة تقليصات عالمية، أعلنت عملاقة التكنولوجيا "ميتا" (الشركة الأم لفيسبوك وإنستغرام وواتساب) عن...

أعلن إيلون ماسك وشركة سبيس إكس عن شراكة مع كريسور، وهي منصة برمجية للذكاء الاصطناعي. مُنحت سبيس إكس خيار...

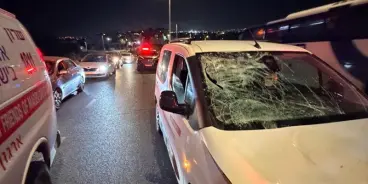

أفاد المتحدث باسم نجمة داوود الحمراء أنه عند الساعة 19:54 ورد بلاغ إلى مركز الطوارئ 101 في منطقة شارون حول إصابة راكب دراجة ناريح بعد تصادم مع مركبة على شارع 574 في...

وفد رفيع المستوى من وزارة التربية والتعليم في زيارة عمل إلى بلدية كفرقرعاستقبلت...

وجهت مجموعة من عضوات الكنيست رسالة رسمية إلى رئيس هيئة الأركان العامة في جيش...

عرضت جيم ستوب شراء جميع أسهم عملاق البيع بالتجزئة عبر الإنترنت إيباي في صفقة تُقدّر قيمتها بنحو 56 مليار دولار، في خطوة غير مألوفة تسعى فيها الشركة للاستحواذ على...

أفادت وكالة الأنباء الفرنسية (أ ف ب)، نقلاً عن بيان حصلت عليه، أن أكثر من 600 موظف في...

في خطوة تعكس موجة تقليصات عالمية، أعلنت عملاقة التكنولوجيا "ميتا" (الشركة الأم...

أعلن إيلون ماسك وشركة سبيس إكس عن شراكة مع كريسور، وهي منصة برمجية للذكاء...